KI-Agenten in der Justiz? Ja, sicher!

Digitale Tools bestimmen längst unseren Alltag. Doch was passiert, wenn Software nicht nur Informationen bereitstellt und Befehle ausführt, sondern selbst über die Vorgehensweise entscheidet? Wenn sie also nicht mehr fragt: «Welche Informationen kann ich dir bereitstellen?», sondern eigenständig agiert und bestimmt, wie sie vorgeht? Genau das tun sogenannte KI-Agenten.

In diesem Blogartikel erfahren Sie:

- was KI-Agenten sind, wie sie funktionieren und worin sie sich von einfachen Automatisierungslösungen unterscheiden,

- welches Potenzial sie für die Justiz haben – und warum ihre Einführung anspruchsvoller ist, als viele glauben,

- welche konkreten Einsatzfelder in der Justiz realistisch und rechtlich vertretbar erscheinen,

- welche technischen, organisatorischen und strategischen Voraussetzungen für den produktiven Einsatz nötig sind,

- und warum jetzt der richtige Zeitpunkt ist, um in Behörden den Aufbau von KI-Kompetenz und die Klärung zentraler Rahmenbedingungen anzugehen.

KI-Agenten sind längst keine Science-Fiction mehr

Stellen Sie sich vor, Sie sagen Ihrem KI-Agenten einfach nur «Ich will dieses Wochenende in Davos verbringen, organisiere das für mich». Ihr persönlicher KI-Agent versteht, was Sie meinen und surft daraufhin selbständig im Internet. Er handelt innerhalb des vorgegebenen Handlungsrahmens und durchsucht dabei beispielsweise Hotelwebseiten, vergleicht Preise, prüft Verfügbarkeiten und bucht dann die passende Unterkunft für Sie. Genau das kann der OpenAI-Agent «Operator» und zeigt damit, was mit autonomen KI-Systemen inzwischen möglich ist, auch wenn sich der Einsatz derzeit noch etwas umständlich gestaltet (👉 hier geht es zum entsprechenden Tagesanzeiger-Beitrag).

Das Potential von KI-Agenten in der Arbeitswelt und die damit verbundene gesteigerte Ressourceneffizienz und Automatisierung komplexer Aufgaben erscheint riesig. Doch ganz so einfach und unkompliziert, wie es auf den ersten Blick wirkt, ist die Einführung nicht. Aktuell geht die Anwendung meist nicht über Proof of Concepts (PoCs) hinaus und tatsächliche Kosten, organisatorische Hürden sowie technologische Komplexität werden häufig unterschätzt [1].

Nicht überall, wo KI-Agent draufsteht, ist auch KI-Agent drin

Viele einfache KI-Tools, wie Chatbots oder automatisierte Workflows, werden heute als angeblich fortschrittliche agentische KI vermarktet. Doch laut Gartner bieten von tausenden Anbietern nur rund 130 tatsächlich die agentischen Fähigkeiten, – also die autonome Ausführung von Aufgaben sowie das Treffen von Entscheidungen im Auftrag der nutzenden Person – die sie versprechen. Hinzu kommt, dass für viele beworbene Einsatzszenarien meist gar keine echte agentische KI nötig ist. Das führt zu überzogenen Erwartungen, Marktverzerrung und einem Phänomen, das Gartner als «Agent Washing» bezeichnet [1].

Doch nicht nur der Reifegrad der Technologie, sondern auch jener der Organisation ist entscheidend, um agentenbasierte KI mit den oben beschriebenen Potentialen wirklich erfolgreich einzuführen. Das heisst es braucht unter anderem eine klare KI-Strategie mit Rückhalt des Managements, eine hohe Datenqualität und -governance sowie die nötigen Kompetenzen der Mitarbeitenden. Derzeit sind gerade einmal 6% der Organisationen überhaupt in der Lage, agentische KI sinnvoll zu implementieren [2].

KI-Agenten kommen – ob die Justiz bereit ist oder nicht

Wer nun davon ausgeht, sich noch nicht mit KI-Agenten beschäftigen zu müssen, liegt falsch: Bis 2028 werden voraussichtlich 15% der täglichen Geschäftsentscheidungen autonom durch KI-Agenten getroffen, während es 2024 noch 0% waren [2]. Denn KI ist nicht einfach nur ein Hype. Ihre Entwicklung reicht zurück bis in die 1950er Jahre, als die Grundlagen für künstliche neuronale Netze – Algorithmen, die der Funktionsweise des menschlichen Gehirns nachempfunden sind – und späteres Deep-Learning gelegt wurden.

Wozu wird die Justiz KI-Agenten einsetzen können?

Im stark regulierten Justizumfeld der Schweiz stellen sich bei neuartigen Softwares immer viele verschiedene Fragen. Bei der Nutzung von Algorithmen sind die Nachvollziehbarkeit und Transparenz der Datenverarbeitung zentrale Prinzipien. Zudem gilt der Grundsatz, dass der Mensch auf Basis der aufgearbeiteten Informationen über das weitere Vorgehen entscheidet.

Die eigenständige Lösungsfindung, die agentische KI verspricht, steht im Gegensatz zum Menschen als letzte Entscheidungsinstanz. Ideale Testfelder müssen sich deshalb an diesem Grundsatz orientieren. Ein mögliches Kriterium wäre beispielsweise, dass der Einsatz nur bei bereits abgeschlossenen Verfahren erfolgt, in denen die juristischen Entscheide bereits vorliegen. Die KI könnte hier etwa die Vorbereitung zur Übermittlung von rechtskräftigen Urteilen an eine andere Behörde übernehmen. Andere repetitive Handlungen wie die Vorbereitung des Geschäftsabschlusses im System oder eines Massengeschäfts für den Versand könnten ebenfalls spannend sein. Für uns ist jedoch klar: ohne den Einbezug der Juristinnen und Juristen ist die Auswahl guter Testfelder unmöglich.

Die KI-Readiness beginnt heute

In den kommenden Jahren werden wir – so wie einst mit dem PC – mit der Unterstützung von KI-Agenten arbeiten. Das bedeutet, dass sowohl Organisationen als auch Individuen lernen und verstehen müssen, wie KI funktioniert. Und das ziemlich zügig.

Diese Entwicklungen darf auch die Justiz nicht ignorieren. Auch wenn besondere Sicherheitsanforderungen bestehen, sollte dies kein Grund sein, direkt von der Nutzung von KI abzusehen. Klar ist, dass «die Gegenseite» – insbesondere in der Strafverfolgung – diese Technologien längst nutzt. Deshalb ist es umso wichtiger, dass auch in den Strafverfolgungsbehörden ein klarer, geregelter Umgang mit KI etabliert wird.

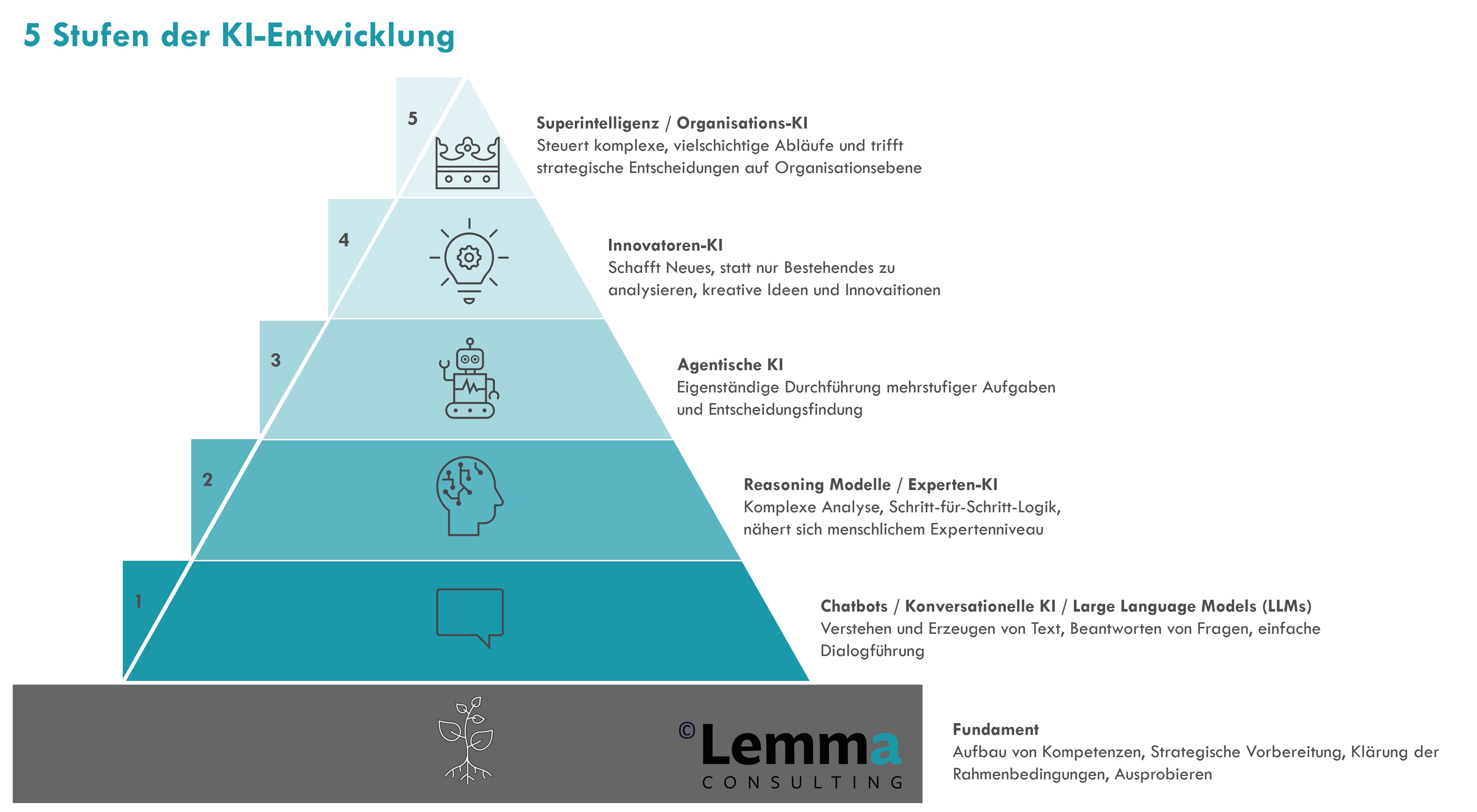

Stufe für Stufe: Von konversationeller KI bis zum autonomen Agenten

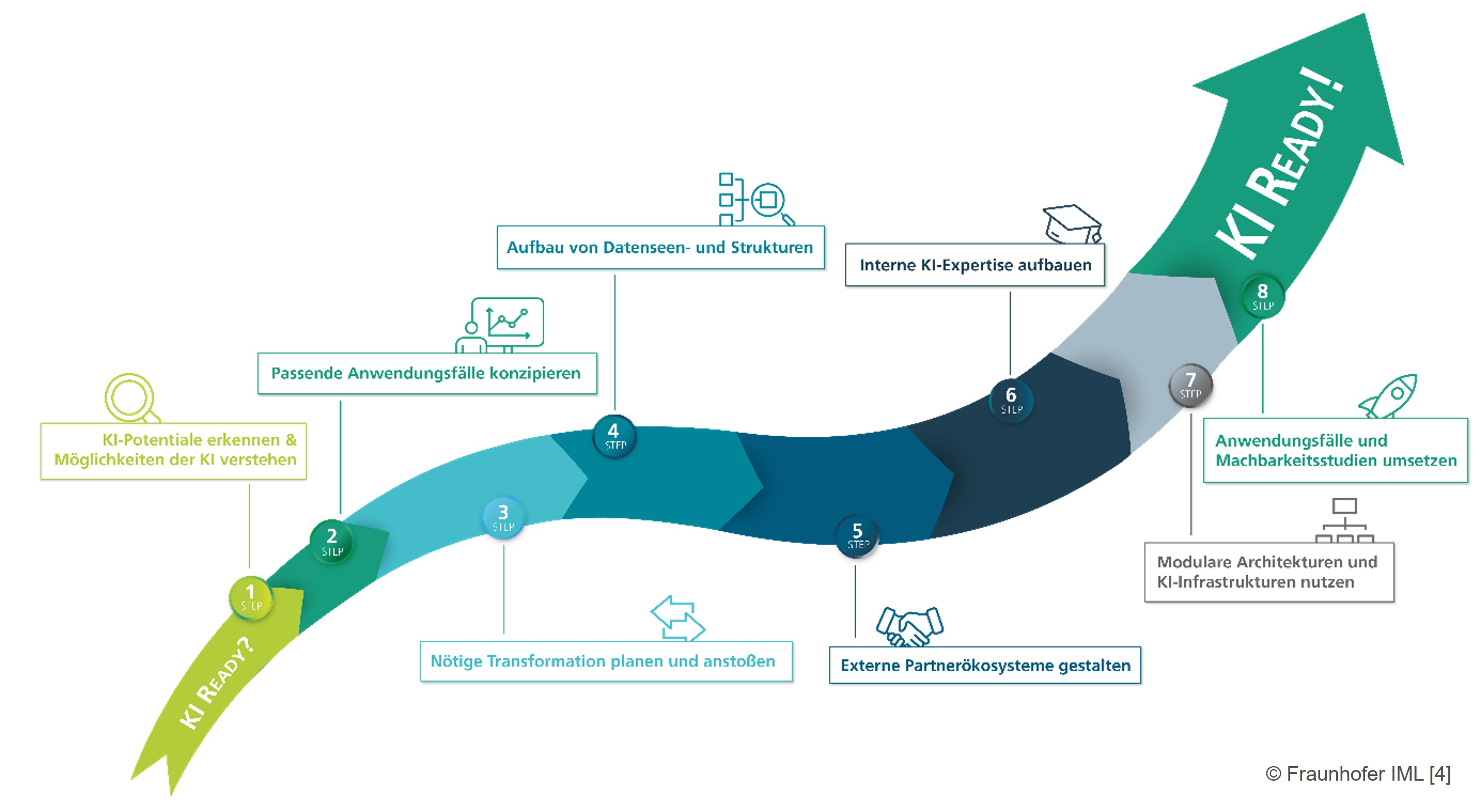

Wer bereits jetzt von der autonomen Massengeschäftsabwicklung durch KI-Agenten träumt, muss sich noch etwas gedulden. Zuerst sind die wichtigsten Grundlagen zu schaffen. Denn der Weg zur tatsächlichen KI-Readiness ist lang und er beginnt bei Behörden mit:

- Digital Playgrounds: Geschützte Räume zum Ausprobieren und Ideen wecken, ohne Zugriff auf sensible Daten

- Aufbau von Kompetenzen: Prompting üben, Ergebnisse kritisch hinterfragen, Verständnis für Machine Learning entwickeln

- Strategische Vorbereitung: Datenqualität sicherstellen, IT-Architektur, Prozessverständnis und Ethikfragen klären.

Behörden können sich so stufenweise in die sichere und vertrauensbasierte KI-Anwendung einarbeiten.

Die fünf Stufen der KI-Entwicklung

Wie beim Hausbau sind zuerst die Planung und das Legen eines guten Fundaments essenziell. Und das dauert manchmal länger als initial gedacht. Es braucht Klarheit bei den wesentlichen Fragen, bevor die Technik produktiv eingesetzt wird. Nichtsdestotrotz haben wir bei Lemma in den letzten Jahren gelernt: «Big design up front» hemmt den Fortschritt, weshalb natürlich auch mit einigen kurzfristigen Initiativen Erfahrungen gemacht werden können. Zentral ist dabei die Einbettung in die strategische Ausrichtung der Behörde, damit die Kräfte gebündelt werden und die Erkenntnisse in die Weiterentwicklung einfliessen können. Sonst müssen Grundsatzfragen z.B. bezüglich Data-Governance immer wieder geklärt werden, weil das Fundament noch nicht gefestigt ist.

Für die «Playgrounds» können konversationelle Tools basierend auf Large Language Models (LLMs) wie ChatGPT-4.5, genutzt werden, um auch eine breitere Mitarbeiterschaft mit den Hilfsmitteln vertrauter zu machen. Danach folgen erweiterte Systeme mit «Chain-of-Thought»-Reasoning, etwa ChatGPT-o4-mini, Claude.Opus 4, Gemini 2.5 Pro.

Erst in Stufe 3 sprechen wir von echten Agenten-KIs basierend auf LLMs, Agenten-Architektur, Task- und Memory-Management. Diese Systeme können komplexe Aufgaben über mehrere Tage autonom, flexibel und kreativ lösen – aktuell noch theoretisch. Denn trotz beeindruckender Automatisierung und Autonomie ist das volle Potenzial einer Agenten-KI noch nicht erreicht. Die Praxis zeigt aber, dass die Übergänge zwischen den Stufen fliessend sind und sich gerade rapide weiterentwickeln.

Was dann folgt ist heute noch Zukunftsmusik. Es wird davon ausgegangen, dass KI irgendwann fähig ist echte Innovationen und neue Lösungsansätze zu schaffen und dann in der letzten Stufe Aufgaben übernehmen kann, für die bislang ganze Organisationen nötig waren. Wann dieser Zeitpunkt erreicht ist, wissen nicht einmal die Top-Experten – dennoch arbeiten die grossen Firmen intensiv daran [3].

KI? Ja, sicher!

Schon heute sollten Behörden rechtliche, technische und organisatorische Rahmenbedingungen klären. Zentral sind Fragen wie:

- Welche KI-Strategie verfolgen wir?

- Welche IT-Architekturbedingungen müssen wir für den KI-Einsatz vorbereiten und umsetzen?

- Entspricht der Einsatz allen geltenden rechtlichen und ethischen Vorgaben (insb. Datenschutz, Grundrechte, Antidiskriminierung)?

- Sind ausreichend qualitativ hochwertige Daten vorhanden und rechtlich nutzbar?

- Wie werden Transparenz, Nachvollziehbarkeit und Erklärbarkeit sichergestellt?

- Wer trägt die Verantwortung bei Fehlfunktionen?

- Wie erfolgt Betrieb, Überwachung und Wartung?

- Wie wird die Integration in bestehende Systeme technisch gesichert?

- Wie sieht das Konzept für Risiko- und Qualitätsmanagement aus?

- Verfügen die Mitarbeitenden über ausreichendes Know-how und sind Schulungen geplant?

- Wie wird die Akzeptanz bei Mitarbeitenden gefördert und sichergestellt?

Und insbesondere: Was bleibt bewusst in menschlicher Hand?

Datenqualität und Interoperabilität als Erfolgsfaktoren

Neben rechtlichen Fragen spielt auch die Datenqualität eine entscheidende Rolle. Schon heute kann in laufenden Digitalisierungsvorhaben im Rahmen des BEKJ darauf geachtet werden, wie Daten strukturiert und zugänglich aufbereitet und zu intelligenten Digitalisaten werden. Zudem ist die Interoperabilität mit anderen Systemen von Bedeutung. Ein Faktor, der bei der Gestaltung neuer IT-Landschaft miteinbezogen werden sollte. Jedes KI-Projekt steht und fällt mit der Datenqualität. Diese kann auch mit überschaubaren Algorithmen getestet werden, damit früh ersichtlich wird, ob sie für die Nutzung in einem komplexeren Modell ausreicht.

Fazit: Auf die Vorbereitung kommt es an

Der Einsatz von KI-Agenten in der Schweizer Strafjustizkette ist kein fernes Zukunftsszenario. Klar kümmert sich die gesamte Branche jetzt um die Einführung des elektronischen Rechtsverkehrs gemäss dem BEKJ. Dennoch ist zu bedenken: wer heute die Weichen richtig stellt, schafft die Grundlage für morgen. Mit solider Datenqualität, klaren rechtlichen Rahmenbedingungen, interoperabler IT-Architektur und echten Lernräumen für Mitarbeitende. Erst wenn diese Basis gelegt ist, kann KI ihr Potenzial in einem klaren Rahmen rechtssicher und effizient entfalten. Der Schlüssel liegt in einem vorausschauenden, schrittweisen Aufbau organisationaler KI-Kompetenz. Nur so kann die Justiz handlungsfähig bleiben in einer Welt, in der autonome Systeme zunehmend Verantwortung übernehmen, ohne dabei die menschliche Urteilskraft zu verdrängen.

Und jetzt? Diskutieren Sie mit uns

- Gibt es bei Ihnen Überlegungen zu KI in der Justiz?

- Wo steht ihre Behörde in diesen Fragestellungen und würden Sie gerne den «Turbo» zünden?

- Bei welchen Geschäften sehen Sie Potenzial für KI-Agenten?

- Wo sehen Sie klare Grenzen?

Sie fragen sich, wie Ihre Behörde konkret vorgehen sollte, um das notwendige Fundament eine künftige KI-Readiness zu schaffen?

Bei Interesse melden Sie sich einfach bei uns. Wir freuen uns auf den Austausch.

👉 Diskutieren Sie mit uns auf LinkedIn.

👉 Oder schreiben Sie uns direkt – wir freuen uns auf Ihre Perspektiven.

Quellen:

[2] https://www.gartner.de/de/informationstechnologie/themen/neue-technologien-im-blick

[3] Interview mit Geoffrey Hinton; ab Minute 11

[4] https://www.iml.fraunhofer.de/de/abteilungen/b2/anlagenmanagement/KI-Readiness.html